En el ámbito acelerado de la tecnología moderna, la capacidad de predecir el futuro se ha convertido en un activo invaluable para las empresas, los investigadores y los tomadores de decisiones. El análisis predictivo, impulsado por la potencia del aprendizaje automático, ha surgido como un campo transformador que permite a las organizaciones extraer información de los datos históricos para predecir resultados futuros. Entre las diversas técnicas de análisis predictivo, los árboles de decisión se destacan como una herramienta poderosa y versátil para comprender patrones complejos y hacer predicciones precisas.

Introducción a los árboles de decisión

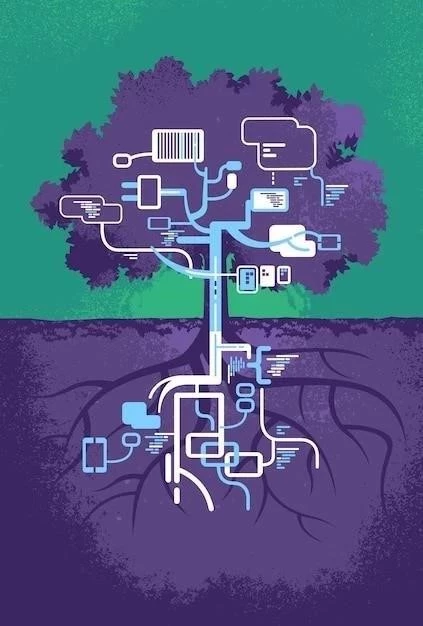

Los árboles de decisión son algoritmos de aprendizaje automático que representan decisiones y sus posibles consecuencias como un árbol de estructura ramificada. Cada nodo interno del árbol representa una prueba o atributo, cada rama representa el resultado de la prueba y cada nodo hoja representa una clasificación o predicción. El proceso de construcción de un árbol de decisión implica dividir repetidamente los datos en subconjuntos más pequeños, hasta que se alcanza un criterio de parada predefinido. Este proceso de división se conoce como partición recursiva.

Construcción de un árbol de decisión

La construcción de un árbol de decisión implica los siguientes pasos⁚

- Selección de la variable raíz⁚ El primer paso es elegir la variable que mejor divide los datos en subconjuntos. Esta variable se convierte en la raíz del árbol. Se utilizan métricas como la entropía, la ganancia de información o el índice Gini para determinar la mejor variable raíz.

- División de los datos⁚ Una vez seleccionada la variable raíz, los datos se dividen en subconjuntos basados en los valores de esa variable. Este proceso continúa recursivamente para cada subconjunto, seleccionando la mejor variable de división para cada nodo.

- Crecimiento del árbol⁚ El proceso de división continúa hasta que se cumplen ciertos criterios de parada, como⁚

- La profundidad máxima del árbol alcanza un límite predefinido.

- El número de muestras en un nodo cae por debajo de un umbral.

- La ganancia de información de la división cae por debajo de un umbral.

- Poda del árbol⁚ Después de que se ha construido el árbol, puede ser necesario podarlo para evitar el sobreajuste. La poda implica eliminar ramas o nodos del árbol que no contribuyen significativamente a la precisión predictiva; Esto ayuda a mejorar la generalización del modelo a datos no vistos.

Aplicaciones de los árboles de decisión en análisis predictivo

Los árboles de decisión tienen un amplio rango de aplicaciones en análisis predictivo, incluyendo⁚

Predicción de clientes

Los árboles de decisión se pueden utilizar para predecir la probabilidad de que un cliente compre un producto o servicio específico, identifique clientes de alto valor o segmente clientes para campañas de marketing personalizadas. Al analizar datos históricos de clientes, como compras anteriores, actividad del sitio web y datos demográficos, los árboles de decisión pueden identificar patrones y tendencias que conducen a predicciones precisas sobre el comportamiento futuro del cliente.

Análisis de riesgo

En finanzas, los árboles de decisión se utilizan para evaluar el riesgo crediticio, predecir la probabilidad de incumplimiento de un préstamo o determinar el riesgo de inversión. Al considerar factores como la historia crediticia, los ingresos y la deuda, los árboles de decisión pueden ayudar a los prestamistas a tomar decisiones de crédito más informadas y a los inversores a mitigar el riesgo potencial.

Diagnóstico médico

En el campo de la salud, los árboles de decisión se utilizan para ayudar a diagnosticar enfermedades, predecir la probabilidad de recurrencia de enfermedades y optimizar los planes de tratamiento. Al analizar los síntomas del paciente, los resultados de las pruebas y los antecedentes médicos, los árboles de decisión pueden proporcionar información valiosa que ayuda a los profesionales médicos a tomar decisiones más precisas.

Mantenimiento predictivo

Los árboles de decisión se pueden utilizar para predecir cuándo es probable que falle un equipo o un componente, lo que permite a las empresas realizar un mantenimiento preventivo y reducir el tiempo de inactividad y los costos. Al analizar datos de sensores, registros de mantenimiento e historial de fallas, los árboles de decisión pueden identificar patrones que indican una falla inminente.

Ventajas de los árboles de decisión

Los árboles de decisión ofrecen varias ventajas sobre otros métodos de análisis predictivo, incluyendo⁚

- Facilidad de interpretación⁚ Los árboles de decisión son fáciles de entender e interpretar, incluso para aquellos que no son expertos en aprendizaje automático. La estructura similar a un árbol permite una visualización intuitiva de las reglas de decisión.

- Manejo de datos mixtos⁚ Los árboles de decisión pueden manejar datos numéricos y categóricos, lo que los hace versátiles para una amplia gama de aplicaciones.

- Alta precisión⁚ Los árboles de decisión pueden lograr una alta precisión predictiva, especialmente cuando se trata de problemas complejos con múltiples variables predictoras.

- Robustez⁚ Los árboles de decisión son relativamente robustos al ruido y los valores atípicos en los datos, lo que los hace adecuados para datos del mundo real que pueden ser imperfectos.

- Identificación de variables importantes⁚ Los árboles de decisión pueden ayudar a identificar las variables más importantes que influyen en la predicción, proporcionando información valiosa para la toma de decisiones.

Desafíos y limitaciones

Si bien los árboles de decisión son poderosos, también tienen algunas limitaciones⁚

- Sobreajuste⁚ Los árboles de decisión pueden sobreajustarse a los datos de entrenamiento, lo que lleva a una baja precisión predictiva para datos no vistos. Esto se puede mitigar mediante técnicas de poda.

- Sensibilidad a los datos ruidosos⁚ Los árboles de decisión pueden ser sensibles a los datos ruidosos o atípicos, lo que puede afectar su precisión predictiva.

- Inestabilidad⁚ Los árboles de decisión pueden ser inestables, lo que significa que pequeñas variaciones en los datos de entrenamiento pueden conducir a árboles de decisión significativamente diferentes.

- Dificultad para manejar datos de alta dimensionalidad⁚ Los árboles de decisión pueden tener dificultades para manejar datos con un gran número de variables, lo que puede resultar en árboles complejos y difíciles de interpretar.

Mejorando la precisión del modelo

Para mejorar la precisión de los modelos de árboles de decisión, se pueden emplear varias técnicas⁚

- Ingeniería de características⁚ La ingeniería de características implica transformar o combinar variables existentes para crear nuevas variables que puedan mejorar la precisión predictiva del modelo. Esto puede incluir la creación de variables interactivas o la transformación de variables categóricas en variables numéricas.

- Preprocesamiento de datos⁚ El preprocesamiento de datos implica limpiar, transformar y preparar los datos para el análisis. Esto puede incluir el manejo de valores faltantes, la eliminación de valores atípicos y la estandarización de las variables.

- Validación cruzada⁚ La validación cruzada es una técnica utilizada para evaluar la precisión predictiva de un modelo en datos no vistos; Implica dividir los datos en conjuntos de entrenamiento y prueba, entrenar el modelo en el conjunto de entrenamiento y luego evaluar su precisión en el conjunto de prueba.

- Poda⁚ La poda es una técnica utilizada para evitar el sobreajuste al eliminar ramas o nodos del árbol que no contribuyen significativamente a la precisión predictiva.

Ética y privacidad en análisis predictivo

El uso de árboles de decisión en análisis predictivo plantea problemas éticos y de privacidad. Es esencial considerar las posibles consecuencias negativas del uso de algoritmos predictivos, como la discriminación, la desigualdad y la violación de la privacidad. Es importante garantizar que los modelos de árboles de decisión se desarrollen y utilicen de manera responsable y ética, teniendo en cuenta los siguientes principios⁚

- Transparencia⁚ Los modelos de árboles de decisión deben ser transparentes y comprensibles, permitiendo a los usuarios comprender cómo se toman las decisiones.

- Imparcialidad⁚ Los modelos de árboles de decisión deben ser imparciales y no discriminar a ningún grupo en particular.

- Privacidad⁚ Los datos utilizados para entrenar modelos de árboles de decisión deben protegerse y utilizarse de manera responsable, respetando la privacidad de los individuos.

- Responsabilidad⁚ Los desarrolladores y usuarios de modelos de árboles de decisión deben ser responsables de las consecuencias de sus decisiones.

Conclusión

Los árboles de decisión son una herramienta poderosa para el análisis predictivo, lo que permite a las organizaciones comprender patrones complejos y hacer predicciones precisas sobre el futuro. Su facilidad de interpretación, manejo de datos mixtos y alta precisión los convierten en una opción atractiva para una amplia gama de aplicaciones. Sin embargo, es esencial abordar los desafíos y limitaciones asociados con los árboles de decisión, como el sobreajuste y la sensibilidad a los datos ruidosos. Al emplear técnicas de preprocesamiento de datos, validación cruzada y poda, se puede mejorar la precisión predictiva de los modelos de árboles de decisión. Además, es crucial considerar las implicaciones éticas y de privacidad del uso de algoritmos predictivos, asegurando que se desarrollen y utilicen de manera responsable y ética.

El artículo es informativo y bien escrito, ofreciendo una visión general completa de los árboles de decisión. La descripción de los pasos de construcción del árbol es clara y concisa. Se podría considerar la inclusión de una sección sobre el uso de árboles de decisión en el aprendizaje por refuerzo, un área donde los árboles de decisión han demostrado ser efectivos.

El artículo es informativo y bien estructurado, proporcionando una base sólida para comprender los árboles de decisión. La explicación de las métricas utilizadas para la selección de variables es precisa y útil. Se podría considerar la inclusión de una sección sobre el uso de árboles de decisión en diferentes escenarios de aplicación, como la clasificación, la regresión y la predicción.

El artículo ofrece una buena introducción a los árboles de decisión, destacando su importancia en el análisis predictivo. La explicación de la selección de la variable raíz es clara y concisa. Se podría ampliar la discusión sobre las diferentes técnicas de poda, como la poda de costo-complejo y la poda de complejidad mínima, para mejorar la generalización del modelo.

El artículo es un buen punto de partida para comprender los árboles de decisión, ofreciendo una explicación accesible de los conceptos básicos. La inclusión de ejemplos prácticos sería beneficiosa para ilustrar mejor la aplicación de los árboles de decisión en escenarios reales. Además, se podría mencionar brevemente las herramientas y bibliotecas de software disponibles para la construcción de árboles de decisión.

El artículo proporciona una buena introducción a los árboles de decisión, destacando su importancia en el análisis predictivo. La explicación de la selección de la variable raíz es clara y concisa. Se podría ampliar la discusión sobre las diferentes técnicas de poda, como la poda de costo-complejo y la poda de complejidad mínima, para mejorar la generalización del modelo.

El artículo proporciona una introducción completa a los árboles de decisión, abarcando los aspectos clave de su construcción y aplicación. La explicación de las métricas de división es clara y precisa. Sería interesante incluir una sección sobre las limitaciones de los árboles de decisión, como la sensibilidad al ruido en los datos y la dificultad para manejar variables con valores continuos.

El artículo ofrece una excelente introducción a los árboles de decisión, destacando su importancia en el análisis predictivo. La descripción de la construcción del árbol es clara y concisa, facilitando la comprensión del proceso. Se podría ampliar la discusión sobre las técnicas de validación cruzada para evaluar el rendimiento del modelo y evitar el sobreajuste.

El artículo presenta una visión general completa de los árboles de decisión, cubriendo aspectos esenciales como la selección de la variable raíz, la división de datos y el crecimiento del árbol. La inclusión de ejemplos y diagramas facilita la comprensión de los conceptos. Sería beneficioso incluir una sección sobre las ventajas y desventajas de los árboles de decisión en comparación con otros algoritmos de aprendizaje automático.

Este artículo ofrece una introducción clara y concisa a los árboles de decisión, un algoritmo fundamental en el ámbito del aprendizaje automático. La explicación de la construcción de un árbol de decisión es particularmente útil, desglosando los pasos clave de manera lógica y accesible. Sin embargo, se podría ampliar la discusión sobre las diferentes técnicas de poda para evitar el sobreajuste, un aspecto crucial para garantizar la generalización del modelo.